前に作った画像のプロンプトがわからなくなっちゃった…😭

Stable Diffusion WebUIで画像を解析してプロンプトを推定することができますよ

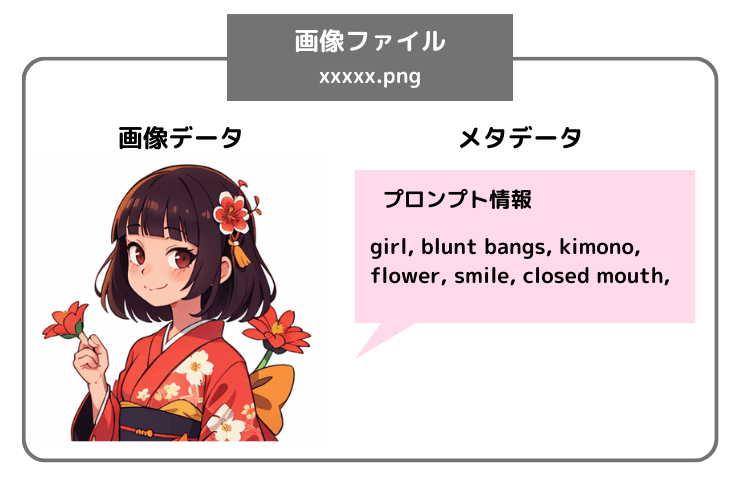

Stable DiffusionやNovelAIで生成した画像ファイルには、プロンプト情報が自動で付与されています。このように画像データそのものとは別に、画像を説明するデータのことを「メタデータ」といいます。

「メタデータが付いている画像」であれば、以下の方法でプロンプトを確認できます。

Stable DiffusionやNovelAIにはメタデータを確認する機能が備わっています。

すでにStable DiffusionやNovelAIを使っているなら、これらを利用するのが簡単です。

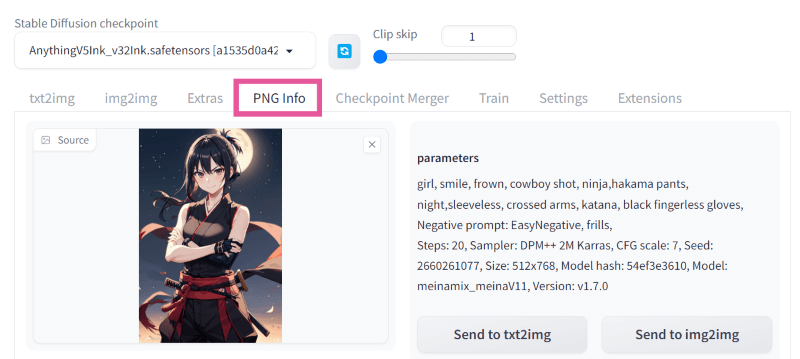

Stable Diffusion(WebUI)での確認方法

Stable Diffusion Web UI(AUTOMATIC1111)では、「PNG Info」タブで画像を読み込ませることでメタデータを確認できます。

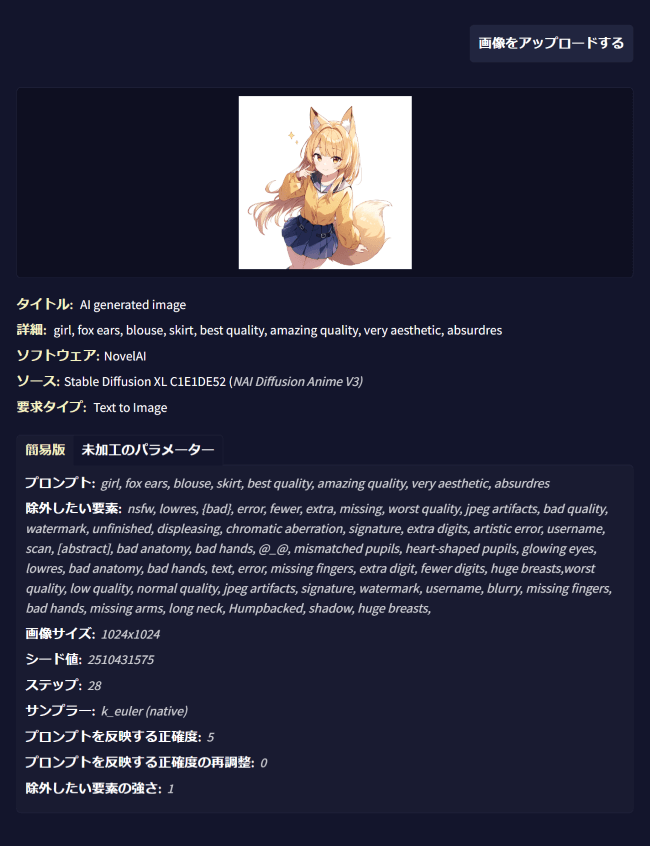

NovelAIでの確認方法

NovelAIの画像ファイル確認ページに画像を読み込ませてメタデータを確認できます。

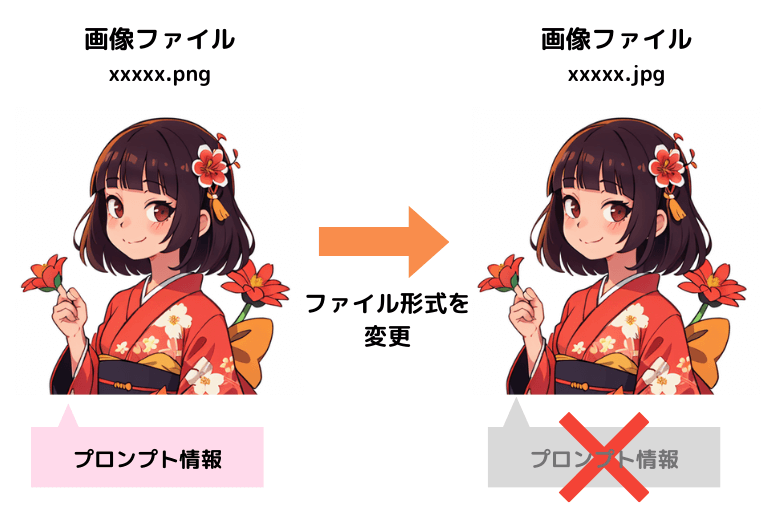

ですが、画像ファイルをたとえばjpgに変更して保存したりすると、付与されていたプロンプト情報は消えてしまいます。

なので、画像はあるけど、元々のプロンプトがわからなくなってしまったということがあります。

それとは別として、他の人の描いた絵を見たときに「この絵はどういうプロンプトから生成したんだろう?」と知りたいこともありますよね。

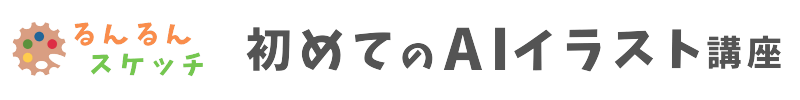

そんなときに役立つのがStable Diffusion WebUIに搭載されている「Interrogate CLIP」と「Interrogate DeepBooru」です。

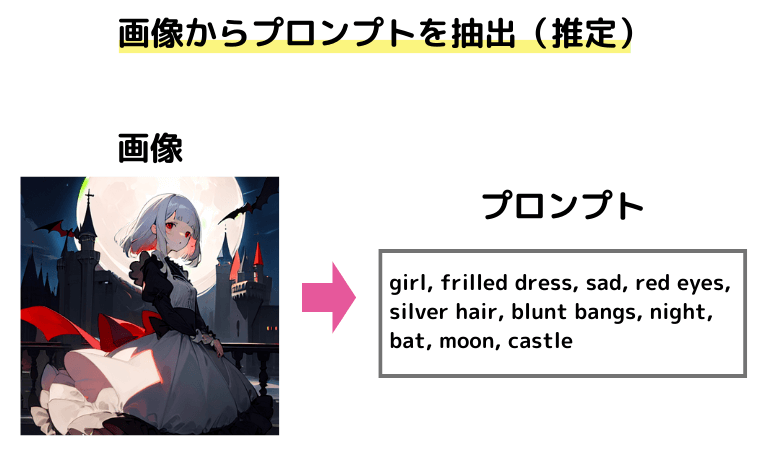

これは、画像から適切なプロンプトを推定することができる機能です。

本記事では、「Interrogate CLIP」と「Interrogate DeepBooru」で画像からプロンプトを抽出する方法や、どこまで適切にプロンプトを推定できるのかについて解説します。

- 過去に生成した画像のプロンプトがわからなくなってしまった

- 参考にするために、他の絵のプロンプトを知りたい

Interrogate CLIP/DeepBooruとは

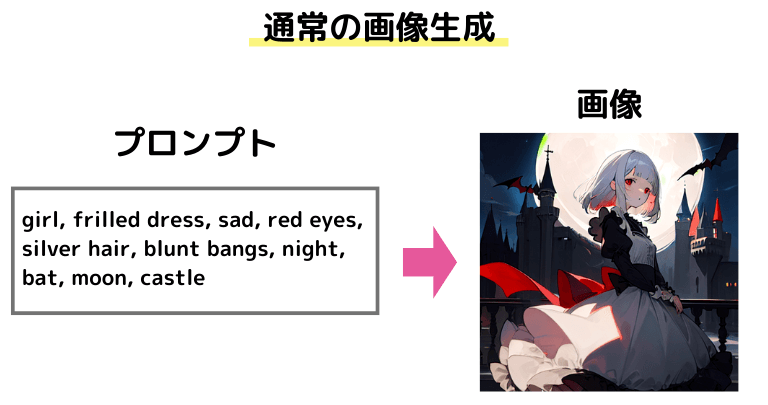

通常であれば、プロンプトから画像を生成します。

「Interrogate CLIP」や「Interrogate DeepBooru」は逆方向、つまり画像からプロンプトを推定する機能です。

このとき解析対象とする画像は、Stable Diffusionで生成した絵である必要はありません。どのような絵・写真であってもOKです。

Interrogate CLIP/DeepBooruの使い方

Stable Diffusion WebUI(AUTOMATIC1111)での「Interrogate CLIP」「Interrogate DeepBooru」の使い方はとても簡単です✨

Interrogate CLIPとInterrogate DeepBooru

まず、「Interrogate CLIP」と「Interrogate DeepBooru」の違いについて説明します。

どちらも画像からプロンプトを推定するという意味ではほぼ同じ機能です。

「Interrogate DeepBooru」では特にアニメ系の画像生成に役立つ「Danbooruタグ」でプロンプトを抽出してくれるという特徴があります。

「Danbooruタグ」??

具体例で見てみましょう♪

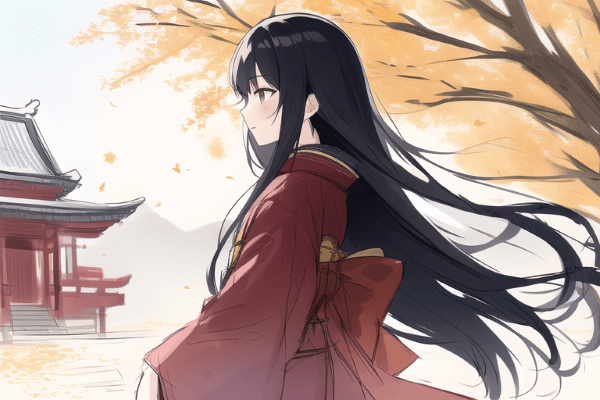

たとえば、下の画像は「girl, long hair,kimono, from side,wind, autumn,temple」というプロンプトを元に、NovelAIで生成した画像です。

この画像を「Interrogate CLIP」と「Interrogate DeepBooru」のそれぞれで解析した結果を比べてみましょう。

girl, long hair, kimono, from side, wind, autumn, temple

まずは、「Interrogate CLIP」で解析してみます。

a woman in a red dress standing in front of a pagoda with long hair in the wind and a tree in the background, Ayako Rokkaku, flowing hair, a manga drawing, romanticism

「Interrogate CLIP」の解析結果は、基本的に「文」になります。

「風になびくロングヘアの女性が赤い服を着て仏塔の前に立っている。背景には木がある。」ということなので、確かに絵のプロンプトとしてはいい感じですね。

では、「Interrogate DeepBooru」で解析するとどうなるでしょうか?

1girl, autumn leaves, bangs, bare tree, black hair, bow, branch, brown eyes, building, floating hair, from side, japanese clothes, kimono, long hair, long sleeves, obi, orange sky, outdoors, profile, red bow, red kimono, sash, sky, solo, sunset, tree, very long hair, wide sleeves, wind

「Interrogate DeepBooru」で解析すると、プロンプトはカンマ区切りの「タグ」になります。

アニメ系の絵を生成している人にとっては、こちらの方が見慣れた形式かもしれません。

この「タグ」は「Danbooruタグ」と言われるもので、Danbooruという海外の画像投稿サイトで使われているタグです。

画像生成AIのモデルを作るときには、大量の学習データが必要となります。そのときには、「画像」と「それを説明するテキスト」が組みになっていなければなりません。

Danbooruというサイトでは、ユーザーが画像を投稿するときに、「画像」とその画像にふさわしい「タグ」をつける仕組みになっているため、学習データとして好都合でした。

それが「Danbooruタグ」ってわけね💡

そうした背景から、NovelAIやStable Diffusionのアニメ系モデルなどでは、プロンプトは「Danbooruタグ」で指定した方が精度がよくなると言われています。

なので、アニメ系の画像に対して解析するときには「Interrogate DeepBooru」を使う方がベターです。

Interrogate DeepBooruの使い方

img2imgタブを開き、解析したい画像をアップロードします。

![[AUTOMATIC1111] Interrogate DeepBooruのやり方](https://runrunsketch.net/wp-content/uploads/2023/09/auto1111_interrogate_1.png)

そして、「Generate」ボタンの下にある「Interrogate DeepBooru」ボタンをクリックします。

少し待つと解析が終わり、プロンプト入力欄に推測したプロンプトが表示されます。

![[AUTOMATIC1111] Interrogate DeepBooruのやり方](https://runrunsketch.net/wp-content/uploads/2023/09/auto1111_interrogate_2.png)

イラストと実写からのプロンプト抽出

プロンプトの解析は「アニメ系イラスト」からでも「実写(写真)」からでも可能です。

アニメ系イラスト

このようなアニメ系イラストからプロンプトを抽出してみましょう。

ここでは「Interrogate DeepBooru」を使ってみます。

1girl, bangs, beach, bird, blonde hair, blue bow, blue eyes, blue neckwear, blue ribbon, blue skirt, blue sky, blush, breasts, cloud, cloudy sky, day, floating hair, flower, horizon, lake, long hair, long sleeves, looking at viewer, medium breasts, mountain, ocean, outdoors, ribbon, seagull, shirt, shore, skirt, skirt hold, sky, smile, solo, very long hair, water, white shirt

ちょっとわかりにくいので、「人物」「服装」「背景」に分解してみましょう。

1girl, bangs, blonde hair, blue eyes, blush, breasts, floating hair, long hair, looking at viewer, medium breasts, smile, solo, very long hair

女の子、金髪のロングヘア、青い瞳、笑顔などの特徴がうまく抽出できています。

blue bow, blue neckwear, blue ribbon, blue skirt, flower, long sleeves, ribbon, shirt, skirt, skirt hold, white shirt

白い長袖シャツに青いリボン、青いスカート、腰元の花、髪に結んだリボンなど、ほぼ完璧です。

beach, bird, blue sky, cloud, cloudy sky, day, horizon, lake, mountain, ocean, outdoors, seagull, shore, sky, water

青い空と白い雲、海辺(水辺)に関連するプロンプトがちゃんと抽出できていますね。

かなり的確にプロンプトを推定できていることがわかります。

実写(写真)

では、今度は実写ではどうでしょうか?「ぱくたそ」の画像を使ってみましょう。

1girl, beach, black hair, braid, cowboy shot, day, footprints, horizon, long hair, ocean, open clothes, open mouth, outdoors, sand, shore, short sleeves, skirt, sky, smile, solo, twin braids, water, waves

「人物」「服装」「背景」のプロンプトに分解してみます。

1girl, black hair, braid, cowboy shot, long hair, open mouth, smile, solo, twin braids

表情(笑顔)や髪型(三つ編みのお下げ)まで抽出できているのは見事です。

open clothes, short sleeves, skirt

服装のプロンプトは少なめですが、半袖+スカートという基本的特徴は押さえていますね。

beach, day, footprints, horizon, ocean, outdoors, sand, shore, sky, water, waves

ビーチ、砂浜という特徴をとらえることができています。footprints(足跡)まで抽出できているのには驚きました。

実写の画像でも適切なプロンプトを推定することができているようです。

こりゃすごいわ!

プロンプト解析の正確性

確かにすごいけど、どこまで正確にプロンプトを抽出できるの?

特に「髪型」や「表情」に関しては、画像を見てもなんと表現していいのか難しいこともあります。

もし画像から適切に「髪型」や「表情」のプロンプトを抽出できると創作にも役立ちそうですね。

実際に試してみたので、結果を見てみましょう!

実力拝見です!

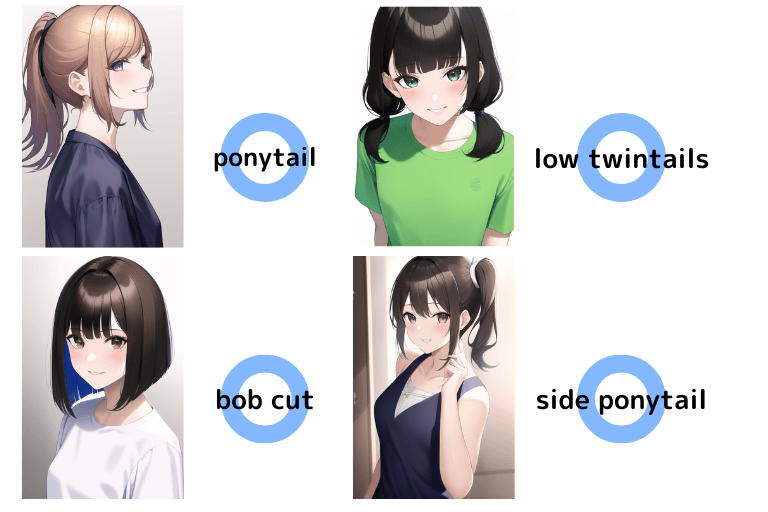

髪型

画像はこちらの記事で使用している私がNovelAIで生成した画像を使います。

最初はこちら。いわゆる「お団子(2つ)」です。「double bun」といいます。

推定されたプロンプトはこちら。

1girl, bangs, bare shoulders, black hair, blush, collarbone, double bun, eyebrows visible through hair, grey background, hair bun, looking at viewer, sidelocks, simple background, smile, solo, upper body

ちゃんと「double bun」を推定できています👏

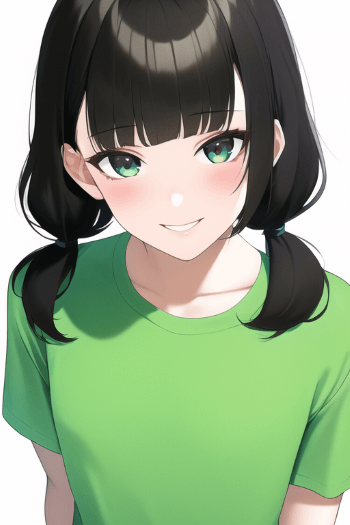

ではこれはどうでしょう?いわゆる「おさげ」です。「low twintails」といいます。

1girl, bangs, black hair, blunt bangs, blush, collarbone, eyebrows visible through hair, green eyes, green shirt, long hair, looking at viewer, low twintails, shirt, short sleeves, short twintails, simple background, smile, solo, t-shirt, twintails, upper body, white background

すばらしい!「low twintails」と推定できています。ついでに、前髪に関しても「パッツン(blunt bangs)」を推定できています。

他の髪型についても試してみたところ、かなりの精度で正しく推定できています。

「Interrogate DeepBooru」は女性の髪型の推定は得意と言えそうです。

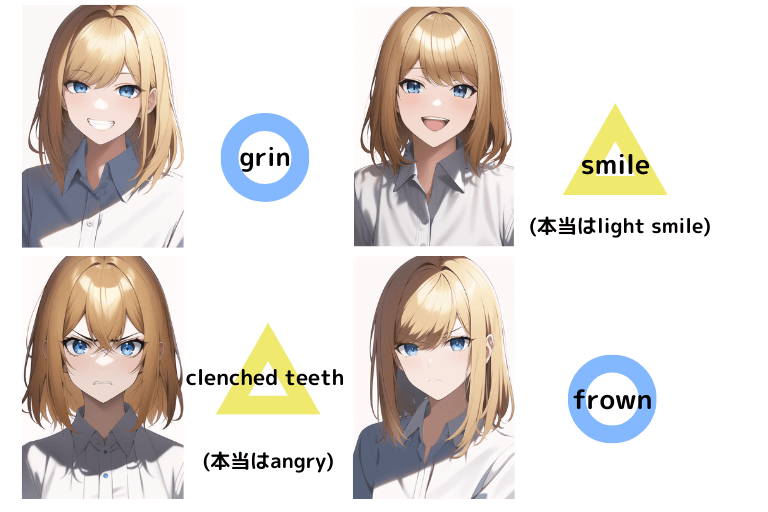

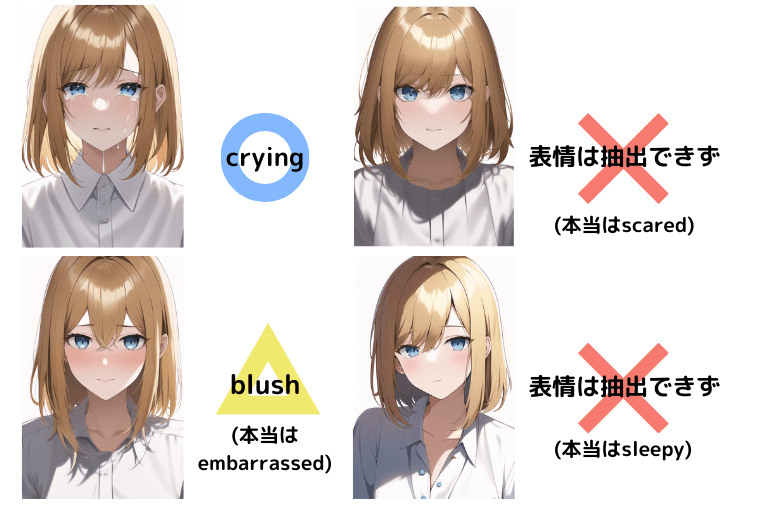

表情

表情に関してはかなり難易度が高いです。

実際に試してみたところ、「smile(笑顔)」や「crying(泣く)」といった特徴的な表情はうまく推定できましたが、「scared(おびえる)」「sleepy(眠たそう)」という微妙な表情に関してはプロンプトを推定できませんでした。

表情に関しては「Interrogate DeepBooru」での解析は難しいかもしれません。

表情のプロンプト(呪文)は以下の記事を参考にしながら、ご自身で推定する方が確実かと思います。

>> 【NovelAI・Stable Diffusion】表情呪文の総まとめ!

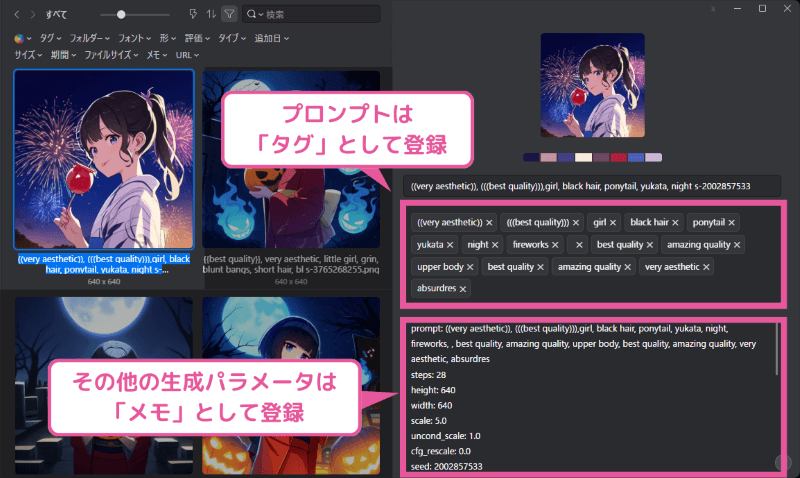

「プロンプト情報」をうまく管理するために

画像を生成したときのプロンプトやネガティブプロンプト、Seedなどの情報は上手に管理しておくと、今後の画像生成にも活かすことができます。

Stable DiffusionやNovelAIで生成した画像には、これらの情報がメタデータとして付与されていますが、毎回ツールを使って読み出すのは大変ですよね💦

そんなときに役立つのが、画像管理ツール「Eagle」です。

「Eagle」ならこんな風に画像のプロンプトやネガティブプロンプト、Seedなどの情報を自動で登録して管理できます。

「この画像のプロンプトはなんだっけ?」というときも一瞬でわかります。また、プロンプト(タグ)で検索をかけて、過去の生成画像から目的の画像を探し出すのも簡単です。

何千枚、何万枚という画像もバッチリ管理できちゃいます✨

AIイラストで大量の画像を扱う人に自信を持ってオススメできる便利ツールです(もちろん、私も愛用しています😄)。

「Eagleのことを知りたい」という人はぜひこちらの記事をご覧ください。料金や使い方、画像生成AIサービスとの連携方法についても詳しく解説しています。

まとめ

Stable Diffusion WebUIの「Interrogate CLIP」や「Interrogate DeepBooru」で、画像からプロンプトを抽出することができます。

特にアニメ系イラストに関しては「Danbooruタグ」でプロンプトを抽出してくれる「Interrogate DeepBooru」がおすすめです。

✅基本的なタグ(呪文)も抑えておこう!

基礎的なタグ(呪文)は身につけておいた方が役立ちます。以下の記事を参考にしてみてくださいね。

その他の当サイトの呪文系記事はこちらです。

コメント